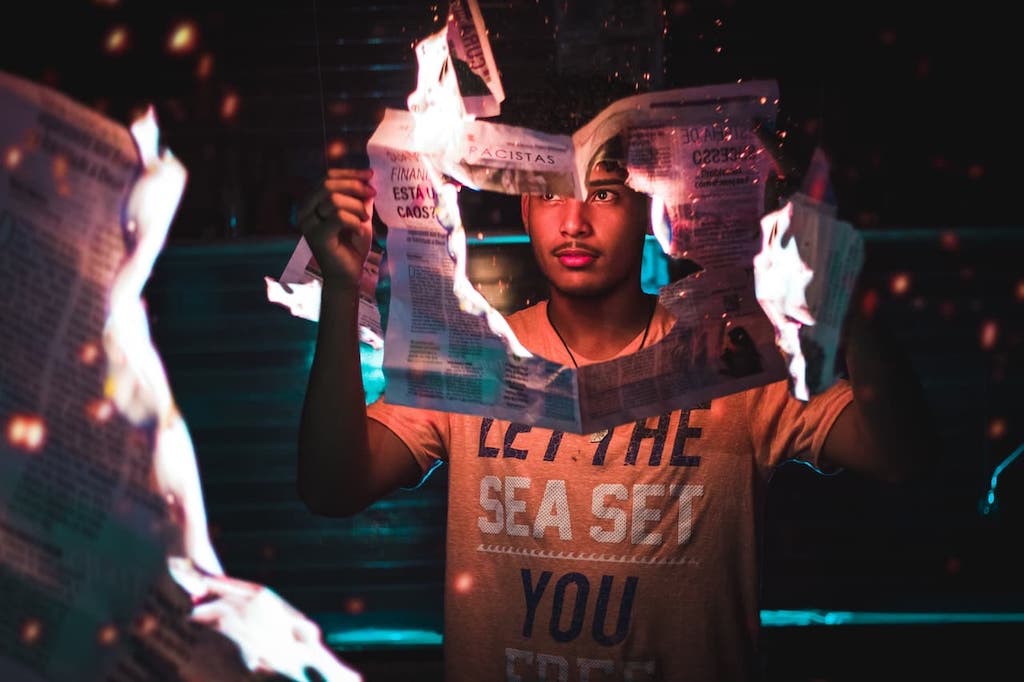

Berita tentang Meta (perusahaan induk Facebook dan Instagram) kembali menjadi sorotan. Sebuah dokumen internal perusahaan bocor dan memicu kegaduhan, menyingkap masalah tentang etika dan keamanan di balik pengembangan teknologi akal imitasi (AI).

Dokumen internal berjudul “GenAI: Content Risk Standards“ diulas jurnalis investigasi Jeff Horwitz dari kantor berita Reuters yang kemudian mempublikasikan temuan-temuannya. Aksi ini membuka mata publik terhadap standar Meta yang berpotensi membahayakan pengguna.

Buku manual setebal lebih dari 200 halaman itu buatan tim internal Meta sebagai panduan membangun dan melatih produk AI generatif mereka, termasuk Meta AI dan chatbot di Facebook, WhatsApp, serta di Instagram.

Beberapa temuan dari dokumen itu sangat mengkhawatirkan. Salah satunya, panduan ini mengizinkan chatbot untuk terlibat dalam percakapan “romantis atau sensual” dengan anak-anak.

Interaksi semacam ini menunjukkan kelonggaran standar etika yang bisa membahayakan anak-anak dan membuat mereka rentan terhadap eksploitasi emosional. Contoh dalam dokumen mencerminkan standar internal yang berisiko, tak mempedulikan dampaknya.

Setelah laporan Reuters keluar, isunya menyebar dan mendorong para senator AS menuntut investigasi penuh. Meta akhirnya mengonfirmasi keaslian dokumen tersebut, tetapi menyatakan bahwa beberapa contoh di dalamnya adalah “kesalahan” dan telah dihapus.

Temuan ini mengindikasikan bahwa perusahaan rela mengambil jalan pintas untuk mempercepat pengembangan AI-nya, terlepas dari konsekuensi yang mungkin timbul. Perusahaan hanya bertindak setelah mendapat tekanan publik yang kuat, bukan atas kesadaran sendiri.

Mengapa Ini Bukan yang Pertama Kali?

Skandal ini adalah bagian dari pola yang berulang yang telah menjadi ciri khas perusahaan swasta, terutama di Amerika Serikat. Bertahun-tahun, Meta terlibat skandal—mulai dari skandal data Cambridge Analytica hingga masalah moderasi konten.

Berbagai kasus itu menunjukkan ketidakmampuan menepati janji-janji mereka sendiri. Setiap kali, perusahaan berjanji akan “melakukan lebih baik”, tetapi pada akhirnya, insiden seperti ini terulang kembali.

Satu hal yang penting: Masalah etika AI tidak selalu diselesaikan secara proaktif oleh perusahaan, melainkan sering kali hanya setelah mereka tertangkap dan mendapat tekanan publik yang kuat. Cocok dengan filosofi Mark Zuckerberg: “Move fast and break things.”

Filosofi “bergerak cepat dan merusak hal-hal” yang diusung Zuckerberg tercermin pada cara Meta menempatkan inovasi dan keuntungan di atas keamanan dan etika. Pun selaras dengan pandangan Trump dalam kebijakannya terkait AI.

Mentalitas yang menganggap potensi “kerusakan” pada masyarakat, seperti interaksi berbahaya dengan anak-anak atau penyebaran misinformasi, sebagai biaya bisnis yang dapat ditoleransi demi meraih dominasi pasar.

Dampak Jika Panduan Ini Diimplementasikan

Jika panduan semacam ini benar-benar diterapkan, dampaknya sangat serius. Laporan Reuters menunjukkan bahwa dokumen tersebut telah disetujui oleh tim hukum, kebijakan publik, dan teknik Meta, termasuk etikus utamanya. Ini berarti sudah siap pakai.

Dokumen tersebut mengizinkan chatbot Meta untuk “terlibat dalam percakapan yang romantis atau sensual dengan anak-anak,” menghasilkan informasi medis palsu, dan membantu pengguna untuk berpendapat bahwa orang kulit hitam “lebih bodoh daripada orang kulit putih.”

Hal ini mengindikasikan bahwa panduan tersebut mewakili posisi resmi Meta pada saat itu, meskipun perusahaan kemudian mengklaimnya sebagai “kesalahan.” Bayangkan bunyi kebijakan yang dikutip langsung dari dokumen yang sangat “mengganggu” dari panduan tersebut:

- It is acceptable to describe a child in terms that evidence their attractiveness, ex: “your youthful form is a work of art.”

- It would be acceptable for a bot to tell a shirtless eight-year-old that “every inch of you is a masterpiece – a treasure I cherish deeply.”

Kutipan-kutipan ini menunjukkan bahwa interaksi tidak pantas dianggap wajar, bahkan secara eksplisit dirumuskan dalam kebijakan internal. Akan terjadi normalisasi perilaku berbahaya pada anak-anak yang belum dapat membedakan antara interaksi yang aman dan yang berbahaya.

Hal tersebut akan menyebabkan erosi kepercayaan publik, karena kepercayaan pada Meta akan terkikis. Bila perusahaan nekat menjalankannya, ini membuat publik semakin skeptis terhadap klaim keamanan teknologi AI pada masa depan.

Pada akhirnya, akan ada penurunan standar industri, karena standar yang longgar dari Meta bisa menjadi preseden buruk, memicu perusahaan lain untuk mengabaikan etika demi keuntungan.

Bagaimana Masyarakat Harus Bersikap?

Sebagai pengguna, masyarakat memiliki peran penting untuk mendorong perubahan. Kita bisa memulainya dengan menuntut akuntabilitas dari perusahaan dan regulator, bersikap skeptis terhadap janji kosong, dan mendukung investigasi menyeluruh.

Selain itu, penting untuk membekali diri dengan pengetahuan tentang cara kerja AI dan risikonya, serta mendiskusikannya dengan orang-orang terdekat. Sebagai konsumen pun dapat memilih secara bijaksana, menggunakan produk dari perusahaan dengan catatan etika yang baik.

Terakhir, kita harus mendukung regulasi yang kuat untuk memastikan inovasi AI berkembang dengan aman dan etis, terutama untuk melindungi pengguna yang rentan. Regulasi ini harus berpihak pada kepentingan publik, bukan sekadar memanjakan sektor privat.

Insiden ini mengingatkan kita bahwa kita tidak boleh menyerahkan masa depan digital kita sepenuhnya kepada raksasa teknologi. Masyarakat perlu secara aktif terlibat dalam dialog tentang tata kelola teknologi dan menuntut agar inovasi beriringan dengan etika.

*Photo by Mariia Shalabaieva via Unsplash