Belakangan ini, banyak poster dan pesan berantai beredar di media sosial yang memperingatkan: “Jangan jawab telepon dengan kata ‘ya’ atau ‘halo’! Penipu bisa merekam suara Anda dan menggunakannya untuk melatih AI meniru suara Anda!”

Peringatan ini membuat banyak orang panik dan takut mengangkat telepon. Tapi, seberapa benar klaim ini? Mari kita pisahkan fakta dari mitos.

Teknologi kloning suara menggunakan kecerdasan buatan (AI) memang nyata dan berkembang sangat pesat. Riset dari McAfee Labs menunjukkan bahwa dengan hanya tiga detik rekaman audio, AI dapat membuat tiruan suara dengan akurasi hingga 85 persen. Dengan lebih banyak data audio dan pelatihan lebih lanjut, akurasi bisa mencapai 95 persen.

Alat seperti ElevenLabs, Resemble.AI, atau teknologi Microsoft VALL-E dapat mengkloning karakteristik unik suara seseorang—termasuk nada, aksen, ritme bicara, bahkan emosi. Beberapa layanan komersial bahkan menawarkan kloning suara dengan harga mulai dari lima dolar per bulan.

Inilah bagian yang sering disalahpahami publik. Meskipun teknologi kloning suara sangat canggih, satu kata seperti “ya” atau “halo” yang diucapkan saat menjawab telepon tidak cukup untuk membuat kloning suara yang meyakinkan.

Para ahli keamanan siber menjelaskan bahwa untuk membuat kloning suara yang realistis, penipu memerlukan:

- Audio yang lebih panjang: Minimal 3 detik untuk hasil dasar, idealnya 1-3 menit untuk kualitas yang baik

- Variasi suara: Rekaman yang menampilkan berbagai pola bicara, intonasi, dan konteks

- Kualitas audio yang baik: Rekaman jernih tanpa terlalu banyak kebisingan latar

Satu kata “ya” atau “Halo” terlalu pendek dan tidak mengandung cukup variasi fonetik untuk melatih model AI secara efektif. Penipuan “bilang ya” atau panggilan yang menanyakan “Kamu bisa dengar saya?” memang ada, tetapi cara kerjanya berbeda dari yang banyak orang bayangkan.

Dalam skema ini, penipu merekam respons “ya” Anda dan kemudian menggunakannya sebagai otorisasi suara palsu untuk transaksi. Misalnya, mengklaim bahwa Anda telah menyetujui pembelian atau layanan tertentu.

Bahaya yang lebih besar adalah konfirmasi bahwa nomor telepon Anda aktif. Ketika Anda menjawab, sistem robocaller menandai nomor Anda sebagai “hidup”, yang kemudian dijual ke jaringan penipuan atau telemarketer lain, menyebabkan lebih banyak panggilan spam.

Sumber Audio yang Benar-Benar Mengancam

Ironisnya, ancaman terbesar kloning suara justru bukan dari menjawab telepon, melainkan dari hal-hal yang kita lakukan secara sukarela:

Media Sosial: Video TikTok, Instagram Reels, cerita Facebook, atau video YouTube di mana Anda berbicara adalah tambang emas bagi penipu. Survei McAfee menemukan bahwa 53 persen orang dewasa membagikan data suara mereka online setidaknya sekali seminggu.

Pesan Suara: Sapaan voicemail pribadi Anda yang direkam dengan suara Anda sendiri.

Video Publik: Presentasi kerja, webinar, podcast, atau video yang Anda unggah secara publik.

Profesor digital forensik dari UC Berkeley, Hany Farid, menjelaskan bahwa dengan 20-30 detik audio, penipu dapat mengkloning hampir semua suara—dalam berbagai bahasa, aksen, usia, atau gender.

Bagaimana Penipuan Kloning Suara Bekerja?

Alih-alih mengumpulkan rekaman dari telepon, penipu menggunakan strategi lebih canggih:

Fase 1: Pengumpulan Intelijen

Penipu meneliti target melalui media sosial dan catatan publik untuk memahami hubungan keluarga, nama anggota keluarga, aktivitas, dan kerentanan.

Fase 2: Pencurian Suara

Mereka mengumpulkan klip audio dari video media sosial atau sumber publik lainnya—bukan dari menjawab telepon.

Fase 3: Serangan yang Dipersonalisasi

Dengan suara yang telah dikloning, penipu menelepon anggota keluarga atau teman, berpura-pura menjadi Anda atau orang yang Anda cintai dalam situasi darurat, meminta uang segera.

Kasus nyata: Jennifer DeStefano menerima panggilan dari suara yang sangat mirip putrinya, mengklaim telah diculik dan meminta tebusan satu juta dolar. Seorang wanita lain kehilangan $15.000 setelah menerima panggilan dari “putrinya” yang menangis.

Cara Melindungi Diri Anda

Berikut langkah-langkah praktis yang jauh lebih efektif daripada takut mengucapkan “ya”:

1. Batasi Jejak Audio Digital Anda

- Pertimbangkan untuk menggunakan sapaan voicemail default dari operator, bukan rekaman suara Anda

- Atur akun media sosial ke mode privat

- Pikirkan dua kali sebelum memposting video dengan suara Anda secara publik

- Hapus atau atur privasi video lama yang mengandung suara Anda

2. Buat “Kata Kode” Keluarga

Tetapkan kata atau frasa rahasia yang hanya diketahui anggota keluarga dekat. Kata ini hanya digunakan untuk memverifikasi identitas dalam situasi darurat. Kriteria kata kode yang baik:

- Unik dan sulit ditebak

- Bukan informasi yang bisa ditemukan online (nama jalan, sekolah, dll.)

- Terdiri dari setidaknya empat kata untuk keamanan lebih baik

- Bahkan bisa sengaja dieja salah agar lebih sulit ditebak

3. Protokol Verifikasi

- Jangan panik: Penipu menciptakan urgensi. Tarik napas dan berpikir jernih.

- Tutup dan hubungi kembali: Jika seseorang mengaku anggota keluarga dalam masalah, tutup telepon dan hubungi mereka di nomor yang Anda ketahui.

- Verifikasi melalui saluran lain: Coba hubungi melalui WhatsApp, SMS, atau anggota keluarga lain.

- Ajukan pertanyaan pribadi: Tanyakan detail yang hanya orang tersebut yang tahu, seperti nama panggilan masa kecil atau kejadian keluarga spesifik.

4. Waspadai Tanda Bahaya

- Permintaan uang mendesak, terutama melalui transfer bank, gift card, atau cryptocurrency

- Instruksi untuk tidak memberitahu orang lain

- Klaim bahwa situasinya “rahasia” atau “mendesak”

- Permintaan metode pembayaran yang sulit dilacak

5. Untuk Panggilan Tak Dikenal

- Jangan menjawab panggilan dari nomor yang tidak Anda kenal

- Jika tidak sengaja menjawab, biarkan penelepon berbicara lebih dulu—jangan langsung mengucapkan “halo” atau “ya”

- Gunakan fitur blokir panggilan di smartphone Anda

- Aktifkan pengaturan “Silence Unknown Callers” (iPhone) atau “Block Unknown Callers” (Android)

6. Perhatikan Keuangan Anda

Jika Anda khawatir telah menjadi target, pantau dengan ketat laporan kartu kredit dan rekening bank untuk transaksi tidak sah.

Respons Industri dan Regulasi

Federal Communications Commission (FCC) AS telah menyatakan panggilan dengan suara buatan AI sebagai “artificial” di bawah Telephone Consumer Protection Act, memberikan perlindungan konsumen yang sama.

FTC meluncurkan Voice Cloning Challenge, mendanai teknologi untuk mendeteksi suara kloning secara real-time, memberi “skor kenyataan” pada audio, atau menambahkan watermark yang tidak terdengar untuk mengganggu proses kloning.

Sementara itu, sekitar 91 persen bank di AS tengah mempertimbangkan kembali penggunaan verifikasi suara untuk klien besar mereka setelah lonjakan insiden penipuan.

Bagaimana dengan Regulasi di Indonesia?

Sayangnya, Indonesia belum memiliki regulasi khusus yang mengatur secara spesifik tentang penyalahgunaan teknologi AI voice cloning. Hal ini menciptakan kekosongan hukum yang membuat penegakan hukum menjadi sulit.

Kondisi Hukum Saat Ini

UU Informasi dan Transaksi Elektronik (ITE) memuat berbagai pengaturan mengenai informasi dan transaksi elektronik, namun tidak menjelaskan secara rinci penyalahgunaan AI dalam voice cloning. Akibatnya, penanganan kasus penipuan menggunakan kloning suara masih menghadapi kendala.

Yang saat ini bisa digunakan adalah:

UU ITE Pasal 28 Ayat 1: “Setiap orang dengan sengaja, dan tanpa hak menyebarkan berita bohong dan menyesatkan yang mengakibatkan kerugian konsumen dalam transaksi elektronik dipidana penjara paling lama 6 tahun dan/atau denda paling banyak Rp1 miliar”.

Namun pasal ini tidak secara spesifik menyebutkan kloning suara, dan penerapannya masih terbatas pada konteks penipuan dalam transaksi elektronik secara umum.

UU Hak Cipta No. 28 Tahun 2014: Suara kloning tidak dapat dilindungi sebagai suatu ciptaan, yang menciptakan celah perlindungan hukum bagi korban.

UU Perlindungan Data Pribadi (PDP): Bisa digunakan jika suara diproses tanpa persetujuan sebagai subjek data, namun penerapannya masih belum jelas dalam konteks kloning suara.

Situasi di Indonesia

Belum ada undang-undang khusus tentang penyalahgunaan suara AI, membuat penegakan hukum sulit. Di Indonesia, ancaman ini sangat potensial menyebar cepat karena minimnya literasi digital masyarakat. Pemerintah Indonesia perlu segera:

- Membuat regulasi khusus yang mengatur penggunaan dan penyalahgunaan teknologi AI voice cloning

- Memperkuat perlindungan data pribadi, khususnya data biometrik suara

- Mengembangkan sistem deteksi dan verifikasi untuk membedakan suara asli dan palsu

- Meningkatkan literasi digital masyarakat tentang bahaya kloning suara

- Menetapkan sanksi tegas bagi penyalahguna teknologi ini

Sambil menunggu regulasi yang lebih memadai, masyarakat harus lebih proaktif melindungi diri sendiri dengan langkah-langkah pencegahan yang telah disebutkan di atas.

Fokus pada Ancaman Nyata

Jadi, benarkah satu kata di telepon bisa membuat suara Anda diklon? Jawabannya: Tidak. Ini adalah mitos yang berlebihan.

Namun, ancaman kloning suara AI itu sendiri sangat nyata—hanya saja sumbernya berbeda. Penipu tidak mengumpulkan suara Anda dari panggilan telepon acak, melainkan dari konten yang Anda bagikan secara sukarela di internet.

Alih-alih takut menjawab telepon, fokuslah pada:

- Membatasi jejak audio digital Anda di media sosial

- Membuat protokol verifikasi dengan keluarga

- Meningkatkan kesadaran tentang cara kerja penipuan ini

- Tidak panik dan selalu memverifikasi sebelum mengirim uang

Teknologi akan terus berkembang, dan begitu pula taktik penipu. Yang terbaik yang bisa kita lakukan adalah tetap terinformasi, waspada, dan berhati-hati terhadap apa yang kita bagikan secara online.

Jika Anda menerima panggilan mencurigakan yang mengaku dari anggota keluarga dalam bahaya:

- Jangan panik

- Tutup telepon

- Hubungi orang tersebut langsung di nomor yang Anda ketahui

- Verifikasi melalui anggota keluarga lain

- Laporkan ke pihak berwenang

Ingat: Penipu mengandalkan kepanikan dan urgensi. Ambil napas dalam, dan verifikasi. Selalu verifikasi.

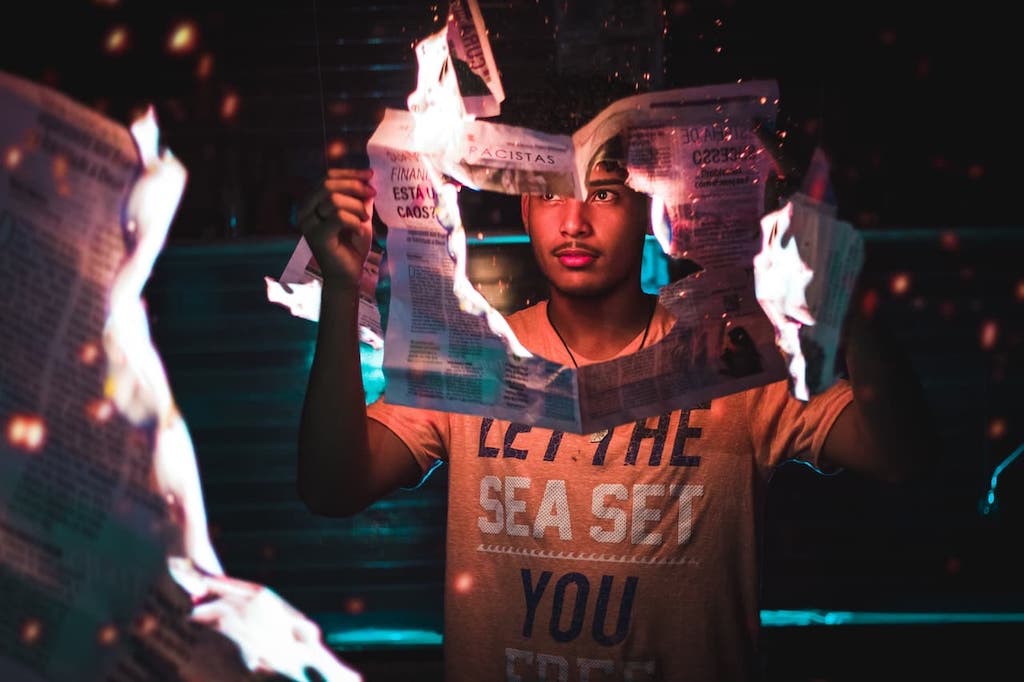

*Photo by Remy Gieling via Unsplash